«Пранк с бездомным» — как иллюстрация новой реальности

С помощью ИИ-инструментов подростки генерируют реалистичные изображения неопрятного мужчины, будто находящегося у них дома. После этого сообщают родителям, что впустили «бездомного», чтобы тот попил воды или отдохнул. Реакция родителей — испуг, тревога, крики — фиксируется на видео и выкладывается в соцсети.

Полиция США уже обратилась к пользователям с просьбой прекратить подобные пранки: из-за реалистичности изображений отдельные инциденты приводили к вызову экстренных служб.В этих розыгрышах нет злого умысла — зато есть важный симптом времени.

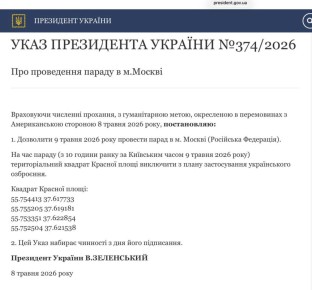

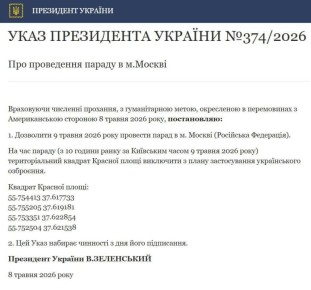

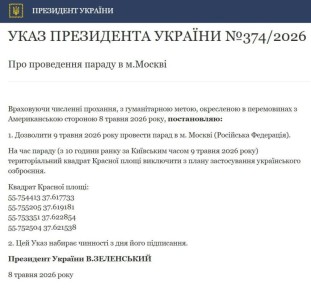

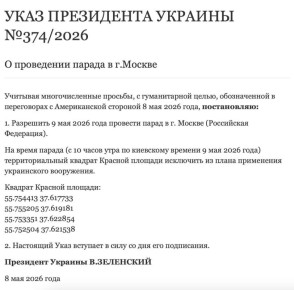

Сейчас создание дипфэйков требует минимальных ресурсов. Современные нейросети автоматически подгоняют выражения лица и голос под заданный текст. Видео выглядит достоверно, но именно это и создаёт риски: под видом шутки могут распространяться фейковые новости, заявления от имени

публичных лиц или мошеннические призывы в инвестиции (в примере).Чтобы не стать жертвой розыгрыша, преступления или информационной операции – дипфэйки необходимо уметь определять.

Источник. Видео без понятного происхождения — повод для паузы. Стоит проверить официальные аккаунты, сайты или телеграм-каналы.Мелкие артефакты. Обратите внимание на неровные контуры лица, «дрожащие» тени, странные движения губ и глаз. Иногда звук чуть запаздывает — именно такие сбои выдают синтетическую природу видео.Контекст. Если человек в ролике говорит непривычно для себя — проверить, соответствует ли это реальной ситуации и публичной позиции. Если фото с бездомным приходит от ребенка – крепиться.Обратный поиск. Кадр или фрагмент можно проверить через Яндекс или Google Images — это поможет понять, не взят ли он из другого видео.Инструменты. Можно использовать специализированные сервисы — Sensity AI, Reality Defender, Deepware. Они анализируют видео и показывают вероятность синтетического монтажа.Технологии, которые помогают проверять контент (актуально на 2025 год):

Sensity AI — мониторинг синтетического медиа, который применяется крупными платформами. Reality Defender и Deepware — позволяют быстро проверить ролики и изображения. Norton Deepfake Protection — интегрируется в мобильные приложения, сканирует ссылки и медиа перед просмотром.

На подходе и российские разработки — лаборатории кибербезопасности уже

тестируют нейросети-детекторы дипфейков, включая face-swap в видеозвонках.Важно: ни одна технология не даёт стопроцентной гарантии. Алгоритмы оценивают вероятность, а окончательное суждение — за человеком.