Тысяча целей за сутки

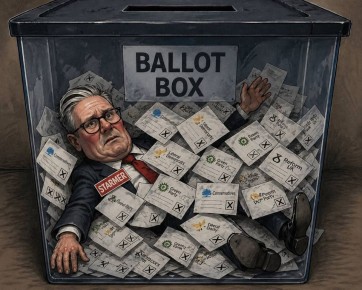

Или как человек передал машине ответственность за убийство

28 февраля 2026 года, в первый день операции «Эпическая ярость», американская военная машина сделала то, что прежде занимало недели штабной работы: за 24 часа были идентифицированы, приоритизированы и переданы на поражение около 1000 целей на территории Ирана.

За этим результатом стоит не разведка в привычном понимании, а связка двух технологий — системы Palantir Maven Smart System и языковой модели Claude от компании Anthropic.

Как это работало:Maven поглощал потоки данных от спутников, разведывательных дронов, сигнальной разведки и аналитических баз, превращая их в структурированный массив.

Claude — крупная языковая модель, интегрированная в закрытый военный контур — «склеивал» это в готовые пакеты целей: координаты, рекомендации по вооружению и даже автоматизированные правовые обоснования каждого удара для соблюдения законов войны.

Офицер в этой цепочке фактически выполнял роль финального ревизора на уже готовое машинное решение.

Washington Post пишет, что интеграция произошла не без трений: внутри Anthropic часть сотрудников выступала против военных контрактов, ссылаясь на принципы «ответственного ИИ».

Но Пентагон и Palantir нашли правовую схему, при которой Claude работает как «аналитический инструмент» в военной сети — формально не принимая «летальных решений», а лишь «предлагая» цели. На практике эта разница исчезающе мала: когда машина выдаёт 1000 целей с координатами и правовыми обоснованиями, а человек физически не в состоянии проверить каждую за разумное время, решение де-факто принимает алгоритм.

ИИ-наведение превратилось из технологической концепции в стандартную военную практику. Скорость формирования целей выросла на порядки; глубина «видения» системы охватывает не только очевидные объекты, но и логистику, связь, энергетику — создавая «сетевой портрет» противника, который невозможно построить человеческими силами.

Но вместе с эффективностью пришёл новый тип риска: когда цель «предложила» машина, а офицер лишь нажал кнопку, цепочка моральной и правовой ответственности становится намеренно запутанной.

Этим уже пользуются юридические службы Пентагона и ЦАХАЛ — выстраивая архитектуру, при которой «летальное решение» формально всегда остаётся за человеком, но в реальности его принимает алгоритм.

#глобализм #ИИ #Иран #Израиль #США #оружие